Lancio di Tenable One AI Exposure: un nuovo standard per proteggere l'uso dell'intelligenza artificiale su larga scala

Scopri e monitora costantemente tutto l'utilizzo dell'IA nell'organizzazione, tra cui la Shadow AI, gli agenti, i plug-in dei browser e altro ancora, con Tenable One AI Exposure. Mappa i flussi di lavoro complessi dell'IA per rivelare le esposizioni ad alto impatto e monitora la conformità alle politiche di sicurezza e di utilizzo accettabile dell'IA.

Punti principali

- Ora disponibile a livello generale su Tenable One Exposure Management Platform, Tenable One AI Exposure offre ai team di sicurezza le capacità di monitorare e proteggere i flussi di lavoro basati sull'intelligenza artificiale.

- Mappa i flussi di lavoro complessi dell'intelligenza artificiale per scoprire come applicazioni, infrastruttura, identità, agenti e dati si combinano per creare esposizioni ad alto impatto.

- Proteggiti dai rischi specifici dell'intelligenza artificiale, come la prompt injection e i tentativi di jailbreak, identificando al contempo i dati sensibili condivisi attraverso i prompt dell'intelligenza artificiale.

La rapida integrazione dell'intelligenza artificiale nelle applicazioni e nelle infrastrutture ha superato la portata della tradizionale sorveglianza della sicurezza. Man mano che gli agenti autonomi e l'IA basata sul cloud diventano centrali nell'impresa, i team di sicurezza si trovano a dover gestire una nuova classe di rischi che gli strumenti tradizionali non sono mai stati progettati per identificare, creando una lacuna critica nella gestione dell'esposizione dell'IA.

Oggi lanciamo Tenable One AI Exposure per fornire ai team di sicurezza le funzionalità necessarie per colmare questa lacuna e mitigare i rischi legati alla sicurezza dell'IA. Ora generalmente disponibili all'interno di Tenable One Exposure Management Platform, queste funzionalità consentono alle organizzazioni di proteggere i flussi di lavoro basati sull'intelligenza artificiale senza rallentare l'innovazione.

Cosa è la lacuna nella gestione dell'esposizione all'IA

La lacuna nella gestione dell'esposizione all'IA si riferisce a tre sfide che i team di sicurezza devono affrontare: la possibilità di vedere come i dipendenti utilizzano l'IA, dove viene eseguita e come l'esposizione all'IA si accumula nei sistemi interconnessi, sia all'interno che all'esterno di un'organizzazione.

L'esposizione all'IA è difficile da valutare per una serie di motivi. Innanzitutto, non si tratta di un rischio informatico tradizionale: non risiede in un unico sistema, non si presenta come una vulnerabilità e non aspetta che gli utenti malintenzionati la sfruttino prima di causare danni. I rischi per la sicurezza dell'intelligenza artificiale si manifestano in:

- Piattaforme di intelligenza artificiale rivolte ai dipendenti, come ChatGPT, Copilot e funzionalità SaaS integrate

- Servizi di intelligenza artificiale e pipeline di modelli basati sul cloud

- API, agenti e plug-in dei browser

- Applicazioni e servizi rivolti al pubblico

Gran parte di questa adozione avviene al di fuori dei tradizionali flussi di lavoro di sicurezza. Le implementazioni di Shadow AI, gli ambienti di test dimenticati, le integrazioni non sicure e i servizi con autorizzazioni eccessive espandono silenziosamente la superficie di attacco, spesso senza che i team di sicurezza si rendano conto della loro esistenza.

Allo stesso tempo, i carichi di lavoro dell'intelligenza artificiale si basano su catene complesse di infrastrutture, identità, API e accesso ai dati. Una singola configurazione errata o un'autorizzazione troppo permissiva possono trasformare l'uso di routine dell'intelligenza artificiale in un'esposizione ad alto impatto.

Poiché le interazioni con l'intelligenza artificiale avvengono costantemente attraverso prompt, caricamenti, risposte e azioni automatiche, anche un uso approvato può esporre involontariamente dati sensibili senza la giusta visibilità e senza i giusti controlli.

Infine, l'esposizione all'IA raramente si presenta come un singolo allarme o asset vulnerabile. Si manifesta invece attraverso le connessioni. Ad esempio:

- Un dipendente utilizza uno strumento approvato da terzi

- Questo strumento invoca un servizio o agente interno di intelligenza artificiale.

- L'agente ha accesso a dati o sistemi sensibili

- Una configurazione errata o un endpoint esposto rende raggiungibile l'accesso.

Singolarmente, ogni componente può apparire innocuo. Insieme, creano un rischio reale.

Gli strumenti di sicurezza tradizionali tendono a considerare questi elementi in modo isolato: talvolta la postura del cloud, altre volte le autorizzazioni per l'identità, mentre altre volte ancora il rischio applicativo. Senza un modo per collegare questi segnali, i team di sicurezza si trovano a reagire ai sintomi invece di gestire l'esposizione.

Lancio di Tenable AI Exposure

Tenable One AI Exposure aiuta i team a colmare questa lacuna di visibilità scoprendo, contestualizzando e dando costantemente priorità all'esposizione legata all'intelligenza artificiale in tutta l'organizzazione, interna ed esterna, in locale e su cloud, per offrire una visione completa e consapevole dei rischi in cui opera l'intelligenza artificiale, delle sue connessioni e dei punti in cui crea esposizione.

A differenza degli strumenti di sicurezza informatica che presentano risultati isolati, Tenable One collega l'intera catena di attività in un'unica vista, mostrando come applicazioni IA, infrastrutture, identità, agenti e dati si combinano per creare rischi reali. Correlando queste relazioni, Tenable One aiuta i team di sicurezza a dare priorità alle esposizioni dell'IA più importanti per ridurre i rischi di sicurezza dell'intelligenza artificiale in tutti gli ambienti.

In che modo Tenable One aiuta a proteggere la superficie di attacco dell'IA

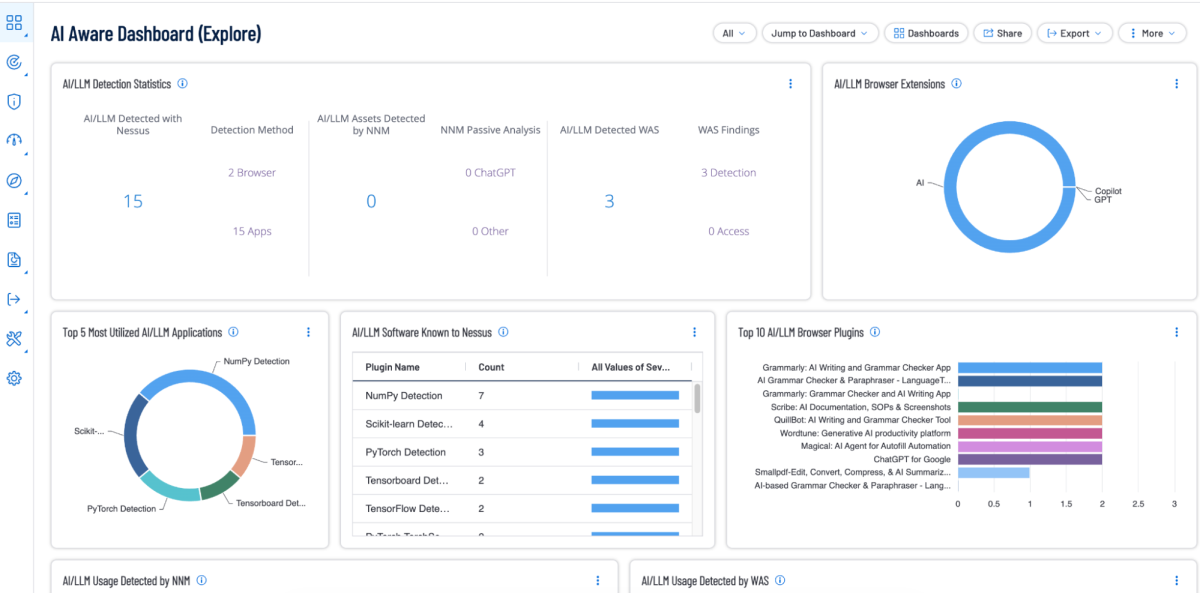

Scopri l'intelligenza artificiale nella tua organizzazione

Non è possibile gestire il rischio dell'IA se non si sa dove opera l'IA.

Tenable One rileva continuamente l'utilizzo dell'IA negli ambienti interni e sulla superficie di attacco esterna, aiutando i team a eliminare i punti ciechi e a mantenere una comprensione aggiornata della portata dell'intelligenza artificiale. Ciò include la visibilità dell'IA approvata e della Shadow AI in applicazioni, endpoint, carichi di lavoro del cloud, API, agenti e servizi esposti pubblicamente.

I team di sicurezza possono individuare dove sono in esecuzione i servizi di IA, quali tecnologie vengono utilizzare in quel momento e come l'esposizione esterna si allinea con la consapevolezza interna.

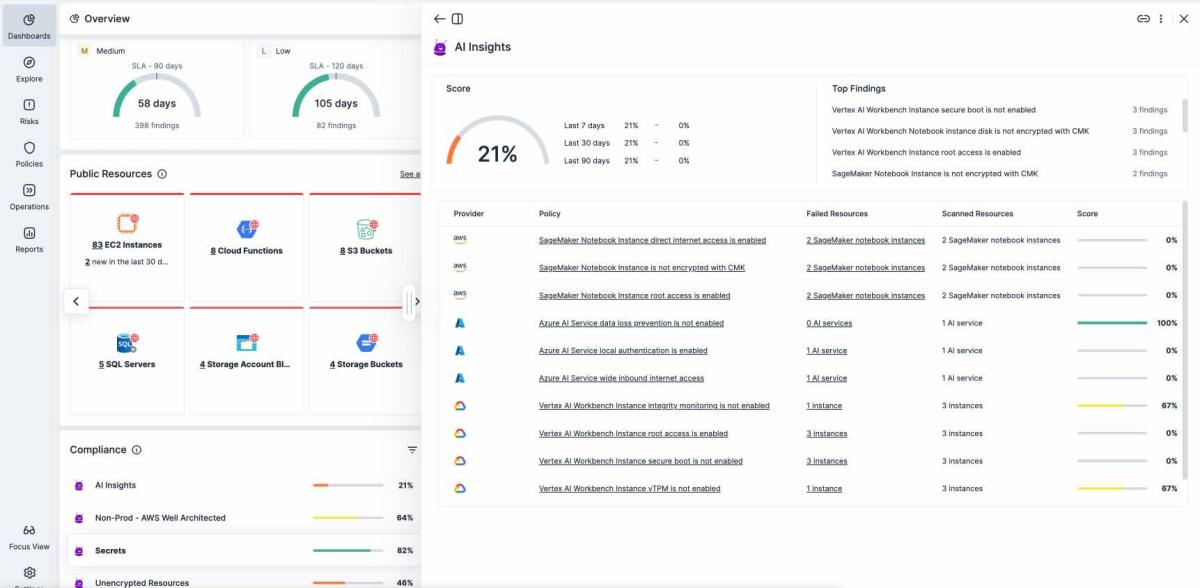

Come l'intelligenza artificiale crea le esposizioni

L'individuazione da sola non è sufficiente. Il rischio dell'IA emerge dal modo in cui i sistemi interagiscono.

Tenable One mappa i flussi di lavoro dell'IA attraverso le piattaforme e i servizi cloud, rivelando come i modelli di IA, l'infrastruttura, l'archiviazione, la rete e i controlli degli accessi lavorano insieme. Evidenzia le vulnerabilità e le configurazioni errate nel software e nelle risorse del cloud legate all'intelligenza artificiale, fornendo al contempo un contesto sui dati e sui sistemi che tali componenti possono raggiungere.

Collegando l'infrastruttura dell'IA con i percorsi di identità e accesso, i team ottengono chiarezza su dove viene effettivamente creata l'esposizione, non solo dove opera l'IA.

Proteggi i carichi di lavoro, i servizi e gli accessi all'intelligenza artificiale

Ridurre il rischio dell'IA significa colmare le lacune sfruttate dagli utenti malintenzionati.

Tenable One aiuta i team a identificare e correggere le configurazioni rischiose nei carichi di lavoro dell'IA e a plasmare gli ambienti prima che possano essere abusati. Inoltre, fa emergere le autorizzazioni eccessive e le debolezze dell'identità legate ai servizi e agli agenti dell'IA, consentendo ai team di applicare l'accesso con il minimo privilegio e di ridurre i percorsi di attacco che mettono a rischio le risorse critiche dell'IA.

Questa visione dell'esposizione basata sull'identità aiuta i team di sicurezza a concentrarsi sulle combinazioni dei più importanti punti deboli.

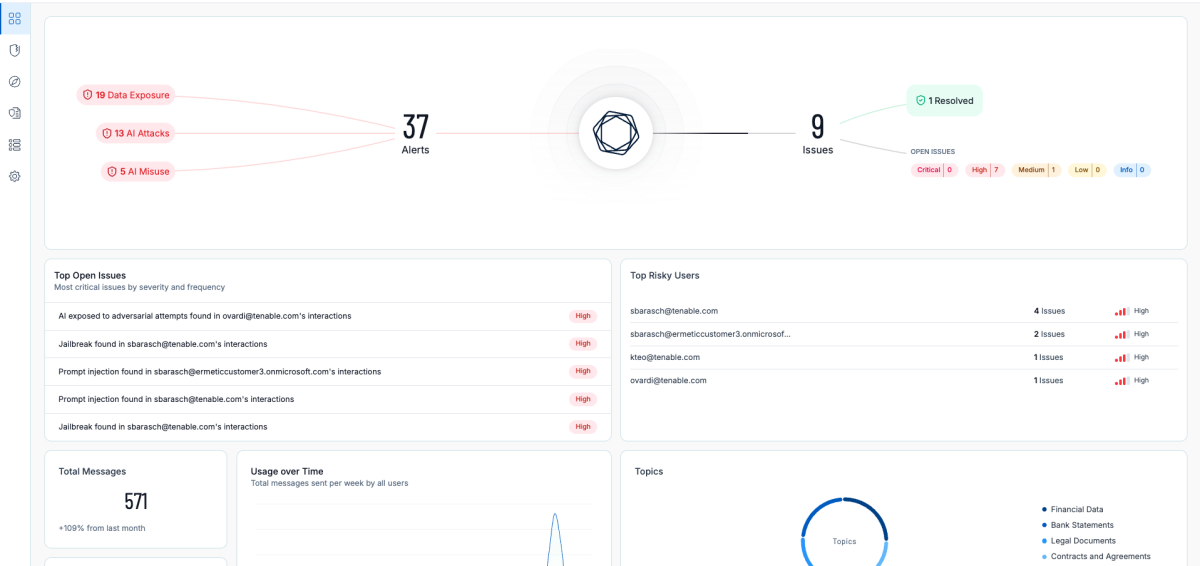

Gestisci l'utilizzo dell'intelligenza artificiale e il flusso dei dati

L'adozione dell'intelligenza artificiale non deve necessariamente avvenire a scapito della sicurezza o della conformità.

Tenable One fornisce visibilità sul modo in cui i dipendenti e gli agenti interagiscono con le piattaforme di IA, compresi strumenti come ChatGPT, Copilot e funzioni di IA generativa incorporate. Mostra anche il modo in cui i dati fluiscono attraverso queste interazioni. I team possono identificare i dati sensibili condivisi tramite prompt o caricamenti, applicare le policy di utilizzo accettabile dell'IA e applicare protezioni che orientano gli utenti verso un comportamento più sicuro dell'IA.

La piattaforma rileva anche le minacce e gli utilizzi errati specifici dell'intelligenza artificiale, come la prompt injection e i tentativi di jailbreak, e fornisce un contesto ad alta fedeltà per favorire una risposta rapida e sicura.

Proteggi l'adozione dell'IA senza rallentare l'innovazione

L'intelligenza artificiale non deve essere il tuo punto debole e la sicurezza non deve essere il freno all'innovazione. Con Tenable One AI Exposure, le organizzazioni possono procedere con fiducia, sapendo di avere un approccio proattivo e pre-violazione alla gestione del rischio dell'IA sull'intera superficie di attacco.

È la prima volta che usi Tenable? Richiedi oggi stesso una demo di Tenable One AI Exposure.

Sei già cliente? Contatta il tuo account team per espandere la copertura di Tenable One includendo l'esposizione all'intelligenza artificiale.

- Exposure Management